Warum wir ein neues Leadership-Framework für KI brauchen

Über KI und Führung wird derzeit viel geschrieben. Die meisten Beiträge bewegen sich dabei in einem vorhersehbaren Korridor: KI als Produktivitätstool, KI als Bedrohung für Arbeitsplätze, KI als Gegenstand einer “Transformation”, die es zu “managen” gilt. Was fast vollständig fehlt, ist eine konzeptionell fundierte Antwort auf die Frage, wie sich Führung selbst verändern muss, wenn Organisationen zunehmend als Mensch-KI-Systeme operieren.

Über KI und Führung wird derzeit viel geschrieben. Die meisten Beiträge bewegen sich dabei in einem vorhersehbaren Korridor: KI als Produktivitätstool, KI als Bedrohung für Arbeitsplätze, KI als Gegenstand einer “Transformation”, die es zu “managen” gilt. Was fast vollständig fehlt, ist eine konzeptionell fundierte Antwort auf die Frage, wie sich Führung selbst verändern muss, wenn Organisationen zunehmend als Mensch-KI-Systeme operieren.

Akademisch existieren durchaus Anknüpfungspunkte. Mary Uhl-Bien, Russ Marion und Bill McKelvey haben bereits 2007 mit der Complexity Leadership Theory (CLT) einen Rahmen geschaffen, der Führung nicht als Eigenschaft einer Person, sondern als emergentes Phänomen in komplexen adaptiven Systemen versteht. Dave Snowdens Cynefin-Framework liefert seit über 25 Jahren ein Sense-Making-Instrument, das Führungskräften hilft, die Natur ihres Entscheidungskontexts zu erkennen, bevor sie handeln. Und Joscha Bachs computationalistische Perspektive auf Kognition und Agency macht präzise, wo die epistemologischen Grenzen maschineller Intelligenz liegen.

Nur: Diese Stränge wurden bisher nicht für die Praxis zusammengeführt. Es gibt akademische Paper über Complexity Leadership und KI, aber keinen einzigen Practitioner-Beitrag, der die Brücke schlägt. Genau das ist die Lücke, die dieser Artikel adressiert.

Die zentrale These lautet: Wer KI sinnvoll in organisationale Entscheidungsprozesse integrieren will, braucht kein besseres Change Management und keine weitere “AI Readiness”-Checkliste. Er braucht ein Verständnis davon, in welcher Art von Entscheidungskontext er sich bewegt, welche Form von Führung dort wirksam ist und wo die systematischen Grenzen maschineller Intelligenz liegen.

Complexity Leadership Theory: Die drei Führungsfunktionen

Um die Verbindung zur KI-Ära herzustellen, brauchen wir zunächst ein sauberes Verständnis der CLT. Mary Uhl-Bien und ihre Kollegen argumentierten 2007, dass die Leadership-Modelle des Industriezeitalters, hierarchisch, personenzentriert, auf Planung und Kontrolle ausgerichtet, für wissensbasierte Organisationen nicht mehr ausreichen. Ihr Alternativvorschlag war nicht einfach ein neues Modell, sondern ein Paradigmenwechsel: Führung als emergente Dynamik in komplexen adaptiven Systemen, nicht als Eigenschaft einzelner Personen.

Die CLT unterscheidet drei miteinander verschränkte Führungsfunktionen, die Uhl-Bien bewusst nicht als “Rollen” oder “Stile” bezeichnete, sondern als Funktionen, die im System auftreten.

Die erste Funktion ist Adaptive Leadership. Sie beschreibt die kreativen, lernenden Interaktionsdynamiken, die entstehen, wenn Akteure in einem System auf Spannungen und Perturbationen reagieren. Adaptive Leadership ist kein geplanter Prozess, sondern emergent. Sie entsteht in den Zwischenräumen, dort, wo heterogene Perspektiven aufeinandertreffen und durch Reibung Neues hervorbringen. Wichtig: Adaptive Leadership ist nicht an hierarchische Positionen gebunden. Sie kann im Vorstand ebenso auftreten wie in einem Werkstatt-Team.

Die zweite Funktion ist Administrative Leadership. Sie umfasst die formalen, strukturgebenden Aktivitäten: Planung, Ressourcenallokation, Krisenmanagement, die Koordination organisationaler Abläufe. Administrative Leadership sorgt für Ordnung und Ausrichtung. Ohne sie degeneriert Anpassungsfähigkeit zu Beliebigkeit. In der originalen CLT wird diese Funktion nicht abgewertet, sondern als notwendiger Gegenpol zur adaptiven Dynamik verstanden.

Die dritte Funktion, Enabling Leadership, ist vielleicht die anspruchsvollste und gleichzeitig die am meisten unterschätzte. Sie beschreibt die Fähigkeit, die Bedingungen zu schaffen, unter denen adaptive Dynamiken entstehen können, ohne sie zu kontrollieren oder zu unterdrücken. Enabling Leader managen die Oszillation zwischen der hierarchischen Logik der Organisation und der emergenten Logik komplexer Systeme. Sie schaffen, was Uhl-Bien und Arena später als “Adaptive Spaces” bezeichneten: dynamische soziale Räume, in denen Neues entstehen kann, ohne die operative Stabilität zu gefährden.

Das Entscheidende an der CLT ist das Konzept der Entanglement, der Verschränkung dieser drei Funktionen. Sie lassen sich analytisch unterscheiden, aber in der Praxis sind sie untrennbar miteinander verwoben. Eine Führungskraft, die nur administrativ führt, erstickt Emergenz. Eine, die nur auf Adaptivität setzt, produziert Chaos ohne Verwertbarkeit. Und Enabling Leadership ohne ein Verständnis beider Pole bleibt wirkungslos.

Cynefin: Das Sense-Making-Instrument, das der CLT fehlt

Die Complexity Leadership Theory sagt, dass unterschiedliche Kontexte unterschiedliche Führungsformen erfordern. Was sie nicht liefert, ist ein diagnostisches Instrument, mit dem Führungskräfte bestimmen können, in welchem Kontext sie sich gerade befinden. Genau hier setzt das Cynefin-Framework an.

Dave Snowden entwickelte Cynefin 1999 bei IBM und hat es seither kontinuierlich weiterentwickelt. Im Kern ist Cynefin kein Kategorisierungssystem, sondern ein Sense-Making-Instrument: Es hilft, die Natur der Kausalbeziehungen in einem gegebenen Kontext zu erkennen, bevor man handelt.

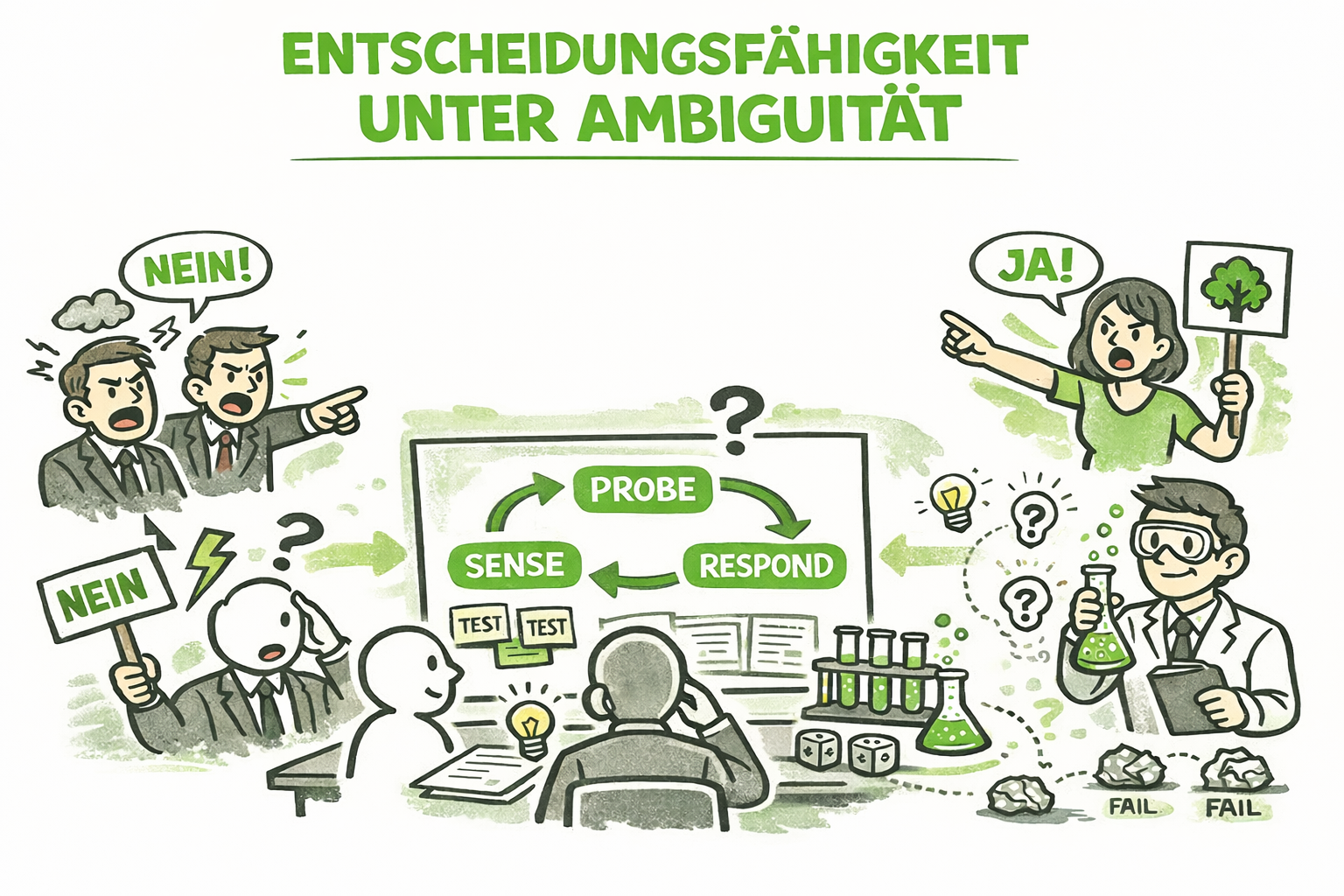

Cynefin unterscheidet fünf Domänen. In der Clear-Domäne (früher: Simple/Obvious) sind Ursache-Wirkung-Beziehungen für alle Beteiligten offensichtlich. Es gibt bewährte Praktiken, die angewendet werden können. Das Vorgehen folgt der Logik “Sense, Categorise, Respond”: Wahrnehmen, einordnen, nach Regel handeln. In der Complicated-Domäne existieren Kausalbeziehungen, aber sie erfordern Expertenwissen oder Analyse, um erkannt zu werden. Hier gibt es nicht eine richtige Antwort, sondern mehrere gute. Das Vorgehen: “Sense, Analyse, Respond.” In der Complex-Domäne, und das ist die entscheidende, können Kausalbeziehungen erst im Nachhinein erkannt werden. Wir befinden uns im Raum der “unknown unknowns”, der unbekannten Unbekannten. Hier versagen Analyse und Planung. Stattdessen braucht es “Probe, Sense, Respond”: kleine, sichere Experimente, deren Ergebnisse man beobachtet und aus denen man lernt. In der Chaotic-Domäne schliesslich gibt es keine erkennbare Ordnung. Hier muss zunächst gehandelt werden, um Stabilität herzustellen, erst dann kann sondiert werden: “Act, Sense, Respond.” Die fünfte Domäne, Disorder oder Confusion, beschreibt den Zustand, in dem unklar ist, in welcher Domäne man sich befindet.

Der tiefere Punkt, den Snowden immer wieder betont und der oft übersehen wird: Die Domänen sind keine Aufgaben, die man in eine Schublade steckt. Sie beschreiben die Natur des Systems, in dem man operiert. Und die gefährlichste aller Führungsentscheidungen ist, die Methoden einer Domäne in einer anderen anzuwenden, also beispielsweise in einer komplexen Situation nach “best practice” zu suchen, die per Definition nur “past practice” sein kann.

KI durch die Cynefin-Linse: Wo maschinelle Intelligenz funktioniert und wo sie scheitert

Und hier wird es für die KI-Debatte relevant. Wenn wir KI-Systeme, insbesondere Large Language Models (LLMs), aber auch Algorithmen der klassischen KI, durch die Cynefin-Linse betrachten, wird ein Muster sichtbar, das die aktuelle Führungsdiskussion fast vollständig ignoriert.

In der Clear-Domäne ist KI hervorragend. Regelbasierte Prozesse, Klassifikation, Standardantworten auf Standardfragen, Datenvalidierung, Routineautomatisierung: Das sind die Aufgaben, für die maschinelle Systeme gebaut wurden. Hier gibt es wenig zu diskutieren. Die Automatisierung dieser Aufgaben ist sinnvoll, effizient und in vielen Fällen längst Realität.

In der Complicated-Domäne ist KI ebenfalls stark, vielleicht sogar stärker als die meisten menschlichen Experten in ihrem jeweiligen Spezialgebiet. Datenanalyse, Mustererkennung in strukturierten Datensätzen, medizinische Diagnostik auf Basis von Bilddaten, Finanzmodellierung, juristische Recherche: In all diesen Bereichen operieren KI-Systeme auf oder über dem Niveau menschlicher Experten, und zwar schneller, günstiger und konsistenter. Die Complicated-Domäne ist der Bereich, in dem die meisten der aktuell diskutierten KI-Anwendungsfälle liegen.

Die Complex-Domäne ist, wo es schwierig wird. Und zwar nicht “noch ein bisschen schwieriger”, sondern kategorial anders. Komplexe Systeme sind per Definition nicht prognostizierbar. Kausalbeziehungen offenbaren sich erst im Nachhinein. Was gestern funktioniert hat, muss morgen nicht funktionieren, weil sich die Randbedingungen verändert haben. In solchen Kontexten braucht es das, was Snowden als “Probe, Sense, Respond” beschreibt: kleine, sichere Experimente, aufmerksame Beobachtung schwacher Signale, und die Fähigkeit, günstige Muster zu erkennen und zu verstärken, bevor sie analytisch greifbar sind.

Genau das können LLMs nicht. Und zwar nicht, weil sie “noch nicht gut genug” sind, sondern aus prinzipiellen Gründen. LLMs sind statistische Modelle, trainiert auf vergangenen Daten. Sie sind Meister der Interpolation: Sie finden Muster in dem, was war. Aber komplexe Systeme erzeugen ständig genuine Neuheit. Sie produzieren Situationen, die in den Trainingsdaten nicht enthalten sein können, weil sie vorher nie existiert haben. Ein LLM, das in einem komplexen Kontext eingesetzt wird, wird mit hoher Konfidenz Antworten liefern, die auf vergangene Muster passen, aber die Gegenwart nicht treffen. Das Perfide daran: Die Antworten werden plausibel klingen, weil sie in der Sprache der Experten formuliert sind. Sie werden nur nicht stimmen.

In der Chaotic-Domäne schliesslich, wo sofortige Handlung gefragt ist und jede Verzögerung den Schaden vergrössert, sind KI-Systeme schlicht nicht handlungsfähig. Sie können nicht “in die Situation hineinspüren”, sie können keine Autorität ausüben, keine Verantwortung übernehmen, keine Richtung vorgeben, wenn alle Koordinaten fehlen. Chaos erfordert menschliche Präsenz, Entschlusskraft und die Bereitschaft, ohne ausreichende Information zu handeln.

Die epistemologische Grenze: Bach trifft Snowden

Um zu verstehen, warum die Grenze zwischen Complicated und Complex für KI nicht einfach “schwierig”, sondern fundamental ist, hilft ein Blick auf die Arbeit von Joscha Bach, einem der profiliertesten Denker an der Schnittstelle von Kognitionswissenschaft und KI.

Bach argumentiert aus einer konsequent computationalistischen Perspektive: Bewusstsein ist für ihn eine simulierte Eigenschaft eines simulierten Selbst, ein Software-Muster, das auf einem Substrat läuft. Das klingt zunächst wie ein Argument für unbegrenzte KI-Fähigkeiten. Aber Bachs Position ist differenzierter. Er unterscheidet klar zwischen Intelligenz (der Fähigkeit, Modelle zu bilden und Probleme zu lösen), Agency (der Fähigkeit, eigenständig Ziele zu setzen und zu verfolgen) und Sentience (der Fähigkeit zu subjektivem Erleben). Aktuelle LLMs, so Bach, sind in einem bestimmten Sinne extrem leistungsfähige Computational Systems, aber ihnen fehlt eine zentrale Eigenschaft: die Fähigkeit, Weltmodelle zu bilden, die auf eigenem Erleben basieren, und diese Modelle kontinuierlich an der Realität zu kalibrieren. LLMs operieren “von aussen nach innen”, trainiert an der Oberfläche menschlicher Kommunikation. Was fehlt, ist der “von innen nach aussen”-Weg: ein System, das sich selbst dabei beobachtet, wie es die Welt beobachtet.

Und hier ergibt sich die bemerkenswerte Konvergenz mit Snowden. Snowdens Ansatz des “Naturalising Sense-making” basiert auf der Überzeugung, dass menschliches Sinnstiften in der physischen, sozialen und kulturellen Einbettung des Menschen wurzelt, in seiner Leiblichkeit, seiner Geschichte, seinen impliziten Erfahrungsmustern. Sense-Making ist für Snowden kein kognitiver Prozess, der sich von seinem Substrat trennen lässt, sondern ein verkörperter Prozess, der auf menschlicher Sensorik und jahrtausendealter evolutionärer Kalibrierung beruht.

Bach und Snowden kommen von radikal unterschiedlichen Ausgangspunkten, der eine vom Strong Computationalism, der andere von der Anthropologie und Komplexitätswissenschaft, und treffen sich in einer gemeinsamen Schlussfolgerung: Maschinelle Systeme können vieles besser als Menschen, aber sie können nicht das, was in komplexen Kontexten den Unterschied macht. Sie können nicht aus Leiblichkeit heraus spüren, nicht aus implizitem Erfahrungswissen heraus urteilen, nicht in Echtzeit an einer sich ständig verändernden Realität kalibrieren.

Für Führungskräfte bedeutet das: Die Grenze der KI-Delegation ist nicht technisch, sondern epistemologisch. Es ist nicht die Frage, ob GPT-5 oder GPT-6 “besser” wird. Es ist die Frage, ob die Art des Problems, vor dem man steht, überhaupt durch Interpolation vergangener Daten lösbar ist oder ob es genuine Neuheit erfordert, die nur durch menschliches Sense-Making zugänglich wird.

Complexity Leadership neu gedacht: Die drei Funktionen im Mensch-KI-System

Wenn wir die CLT, Cynefin und die Bach/Snowden-Perspektive zusammenführen, ergibt sich ein Orientierungssystem, das deutlich weiter reicht als alles, was die aktuelle “AI Leadership”-Literatur bietet.

Beginnen wir mit Administrative Leadership im KI-Zeitalter. Die administrative Führungsfunktion betrifft Struktur, Koordination, Governance und die Verwaltung organisationaler Ressourcen. In diesem Bereich liegt das grösste Automatisierungspotenzial, und gleichzeitig entstehen hier neue Führungsaufgaben, die es vorher nicht gab.

Nehmen wir ein konkretes Beispiel: Ein Bereichsleiter in einem mittelgrossen Maschinenbauunternehmen hat bisher viel Zeit damit verbracht, Berichte zusammenzutragen, Budgets zu konsolidieren, Meetings zu koordinieren und Entscheidungsvorlagen aufzubereiten. Ein grosser Teil dieser Arbeit kann durch KI-Systeme übernommen oder zumindest massiv beschleunigt werden. Das ist die gute Nachricht.

Die schlechte Nachricht, oder besser: die anspruchsvolle, ist, dass damit die Legitimation dieser Führungskraft nicht mehr in ihrer Informationshoheit oder Koordinationsleistung liegt. Wenn jeder im Team Zugang zu den gleichen KI-gestützten Analysen hat, verschiebt sich die Führungsaufgabe: weg vom Zusammentragen und Aufbereiten, hin zum Interpretieren, Kontextualisieren und Entscheiden. Administrative Leadership wird nicht überflüssig, sie wird anspruchsvoller. Hinzu kommt eine völlig neue Governance-Aufgabe: Wer definiert, welche Entscheidungen an KI-Systeme delegiert werden dürfen und welche nicht? Wer haftet, wenn ein automatisierter Prozess fehlerhafte Ergebnisse produziert? Wer stellt sicher, dass die Organisation nicht schleichend ihre eigene Urteilsfähigkeit verliert, weil “die KI das doch kann”? Das sind genuin neue Führungsaufgaben, die in keinem der gängigen AI-Readiness-Frameworks vorkommen.

Adaptive Leadership im KI-Zeitalter betrifft den Kern dessen, was Organisationen anpassungsfähig macht: die emergente, kreative Dynamik, die entsteht, wenn Menschen mit unterschiedlichen Perspektiven unter produktiver Spannung zusammenarbeiten. Hier liegt der Bereich, in dem KI am wenigsten beitragen kann und am meisten Schaden anrichten kann, wenn sie falsch eingesetzt wird.

Meiner Beobachtung nach, und das bestätigt die Forschung, liegt die grösste Gefahr nicht darin, dass KI adaptive Prozesse ersetzt. Die Gefahr ist subtiler: KI kann adaptive Prozesse unterdrücken, indem sie den Anschein von Wissen erzeugt, wo in Wahrheit Unsicherheit herrscht. Ein Team, das vor einer komplexen strategischen Entscheidung steht, wird heute mit hoher Wahrscheinlichkeit ein LLM befragen. Das Modell wird eine eloquente, strukturierte, referenzenreiche Antwort liefern. Und genau das ist das Problem: Die Antwort wird die Spannung auflösen, die für adaptive Prozesse notwendig ist. Sie wird den Eindruck vermitteln, die Frage sei beantwortet, obwohl sie in Wahrheit nur überdeckt wurde.

Ich erlebe das in meiner Beratungsarbeit zunehmend. Führungsteams, die mir sagen: “Wir haben das schon durch Claude/ChatGPT laufen lassen, hier ist die Analyse.” Was sie oft nicht sehen: Die “Analyse” ist eine Interpolation vergangener Muster, verpackt in die Sprache ihrer Branche. Sie klingt richtig, weil sie vertraut klingt. Aber in einer komplexen Situation ist “vertraut” ein Warnsignal, nicht ein Qualitätsmerkmal.

Adaptive Leadership in Mensch-KI-Systemen erfordert deshalb eine Kompetenz, die paradox klingt: die Fähigkeit, KI-Output als Hypothese zu behandeln, nicht als Antwort. Das Cynefin-Vokabular hilft hier: In der Complex-Domäne sind KI-generierte Analysen “Probes”, nicht “Solutions”. Sie können als Ausgangspunkt für Experimente dienen, als Provokation, als Kontrastfolie. Aber sie dürfen nicht den Platz einnehmen, den menschliches Sense-Making einnehmen muss.

Enabling Leadership schliesslich, die dritte CLT-Funktion, wird im KI-Zeitalter zur vielleicht wichtigsten und am wenigsten verstandenen Führungsaufgabe. Enabling Leadership schafft die Bedingungen, unter denen adaptive Dynamiken entstehen können. In Mensch-KI-Systemen bedeutet das konkret: Sie gestaltet die Schnittstelle zwischen maschineller Effizienz und menschlicher Emergenz.

Ein COO, der seinen Bereich auf KI-gestützte Prozesse umstellt, steht vor einer Entscheidung, die selten als Führungsentscheidung erkannt wird: Wie viel Variabilität lasse ich im System zu? KI-Systeme tendieren zur Optimierung, zur Standardisierung, zur Reduktion von Varianz. Das ist in der Clear- und Complicated-Domäne genau richtig. Aber in der Complex-Domäne ist Variabilität eine Ressource, kein Problem. Enabling Leadership bedeutet hier: bewusst Räume zu schaffen, in denen menschliche Akteure von der KI-Empfehlung abweichen können und sollen. Das erfordert Strukturen, die nicht nur Effizienz belohnen, sondern auch das produktive Unbehagen, das entsteht, wenn die KI “A” sagt und ein erfahrener Mitarbeiter “aber…” sagen will.

Snowden spricht hier von “Exaptive Innovation”, der Nutzung bestehender Fähigkeiten für völlig neue Zwecke. Enabling Leadership in Mensch-KI-Systemen fördert genau das: Sie ermöglicht, dass menschliche Intuition und Erfahrung als Korrektiv und als Quelle genuiner Neuheit wirken können, anstatt im Strom optimierter KI-Empfehlungen unterzugehen.

Was das für die Praxis bedeutet: Drei Orientierungspunkte

Wenn ich mit Führungsteams an diesem Thema arbeite, kommen die Diskussionen meiner Erfahrung nach an drei Kernpunkten zusammen, die ich hier bewusst nicht als “Empfehlungen” formuliere, weil die Antworten kontextabhängig sind, sondern als Orientierungspunkte.

Der erste Orientierungspunkt ist die Umstellung von Output-Messung auf Vektormessung. Die meisten Organisationen messen Ergebnisse: Umsatz, Kosten, Durchlaufzeiten, Kundenzufriedenheit. Das sind legitime Metriken für die Clear- und Complicated-Domäne. In der Complex-Domäne sind sie trügerisch, weil sie auf der Annahme stabiler Kausalbeziehungen beruhen, die dort nicht gegeben sind. Die Alternative ist Vektormessung: Nicht “wo stehen wir?”, sondern “in welche Richtung bewegen wir uns, und wird die Richtung besser oder schlechter?” Das klingt abstrakt, ist aber operationalisierbar. Snowdens SenseMaker-Methode beispielsweise arbeitet mit verteilter Ethnographie: Viele Menschen in der Organisation erzählen Mikro-Narrationen über ihren Arbeitsalltag und verorten diese selbst auf definierten Dimensionen. Daraus entsteht kein Durchschnittswert, sondern ein Muster, ein Vektor, der zeigt, in welche Richtung sich die gelebte Realität der Organisation bewegt, unabhängig davon, was die offiziellen KPIs sagen. Für Mensch-KI-Systeme ist das besonders relevant: KI kann Vektoren nicht selbst setzen, sie hat kein “Wohin”. Aber sie kann bei der Mustererkennung in den Narrationen helfen, vorausgesetzt, die Interpretation bleibt menschlich.

Der zweite Orientierungspunkt betrifft die Dekomposition der Gegenwart. Die meisten KI-Strategien in Organisationen folgen einer Zukunftslogik: “Wo wollen wir in drei Jahren sein? Welche KI-Fähigkeiten brauchen wir dafür?” Das ist Complicated-Denken, angewendet auf eine komplexe Situation. Die Alternative ist, die Gegenwart zu zerlegen: Welche Constraints wirken aktuell? Welche davon sind veränderbar, welche nicht? Wo gibt es Möglichkeitsräume (“Adjacent Possibles” im Sinne Kauffmans), die bisher nicht genutzt werden? Diese Denkweise, die Snowden als “Estuarine Mapping” formalisiert hat, ist für KI-Integration deshalb so wertvoll, weil sie die Frage umkehrt: Nicht “wie setzen wir KI ein?”, sondern “welche Constraints in unserem System könnte KI verändern, und welche Möglichkeitsräume würden sich dadurch öffnen?” Das ist ein fundamental anderer Startpunkt als eine “AI Roadmap”.

Der dritte Orientierungspunkt ist die Amplifikation günstiger Muster. In komplexen Systemen lässt sich die Zukunft nicht planen, aber die Gegenwart lässt sich gestalten, indem günstige Muster verstärkt und ungünstige gedämpft werden. Für Führungskräfte in Mensch-KI-Systemen heisst das: Nicht fragen “Was ist der optimale KI-Einsatz?”, sondern beobachten, wo KI-Einsatz bereits heute zu besseren Ergebnissen führt, und diese Muster verstärken. Gleichzeitig: beobachten, wo KI-Einsatz zu Homogenisierung, Dequalization von Erfahrungswissen oder schleichender Urteilserosion führt, und diese Muster aktiv dämpfen.

Ein Beispiel aus meiner Praxis: In einem grösseren Reorganisationsprojekt im öffentlichen Sektor beobachte ich, wie Teams KI-Tools unterschiedlich nutzen. Einige verwenden sie als Sparringspartner, generieren Optionen, verwerfen die meisten davon und entwickeln daraus eigene Ideen. Andere verwenden sie als Entscheidungsersatz, übernehmen den Output mehr oder weniger direkt. Das erste Muster ist adaptiv und sollte verstärkt werden. Das zweite ist problematisch, nicht weil die KI-Ergebnisse schlecht wären, sondern weil die Fähigkeit zur eigenständigen Urteilsbildung verkümmert.

Die realitätswirksame Entscheidung: Leadership als Grenzmanagement

Was bedeutet das alles für den Führungsbegriff selbst? In der Arbeit am xm-institute haben wir eine Führungsdefinition entwickelt, die sich bewusst von der gängigen Leadership-Literatur absetzt: Führung ist die Fähigkeit, realitätswirksame Entscheidungen zu treffen. “Realitätswirksam” bedeutet nicht “mutig” oder “hart”, sondern: Entscheidungen, die die Realität tatsächlich bewegen. Die den Zustand eines Systems verändern. Die nicht nur auf dem Papier existieren, sondern in der gelebten Organisationsrealität ankommen.

Im Kontext von Mensch-KI-Systemen bekommt diese Definition eine zusätzliche Dimension. Die realitätswirksamste Entscheidung, die eine Führungskraft heute treffen kann, ist die Grenzentscheidung: Wo endet die Domäne der KI, und wo beginnt die Domäne menschlicher Urteilskraft? Diese Grenze ist nicht statisch. Sie verschiebt sich mit der Leistungsfähigkeit der Systeme, mit der Erfahrung der Organisation im Umgang mit KI, mit der Veränderung der Problemlandschaft. Die Aufgabe von Enabling Leadership ist es, diese Grenze kontinuierlich neu zu verhandeln, nicht einmal zu setzen und dann zu vergessen.

Das ist anspruchsvoller als jede “AI Transformation”. Es erfordert, dass Führungskräfte drei Dinge gleichzeitig können: erstens die Natur ihres Entscheidungskontexts diagnostizieren (Cynefin), zweitens die richtige Führungsfunktion für diesen Kontext aktivieren (CLT) und drittens die epistemologischen Grenzen der eingesetzten KI-Systeme kennen und respektieren (Bach/Snowden).

Fazit: Die leise Gefahr und die stille Chance

Die grösste Gefahr der KI-Ära ist nicht, dass Maschinen uns die Arbeit wegnehmen. Sie ist, dass wir aufhören, das zu tun, was uns in komplexen Situationen unverzichtbar macht: wahrnehmen, was noch nicht in Daten vorkommt. Spüren, was sich gerade verändert. Urteilen, ohne auf Vollständigkeit der Information warten zu können. KI ist exzellent darin, das Bekannte zu optimieren. Aber die Zukunft lebt im Unbekannten.

Gleichzeitig liegt in dieser Konstellation eine Chance, die ebenfalls kaum diskutiert wird. Wenn KI die Clear- und Complicated-Aufgaben übernimmt, wird Führungskapazität frei, und zwar für genau die Arbeit, die in den letzten Jahrzehnten chronisch zu kurz gekommen ist: das Schaffen von adaptiven Räumen, das Wahrnehmen schwacher Signale, das Ermöglichen von Emergenz. Führungskräfte, die bisher 70 Prozent ihrer Zeit mit Reporting, Koordination und Informationsaufbereitung verbracht haben, könnten diese Zeit für das nutzen, was tatsächlich Führung ist: realitätswirksame Entscheidungen in komplexen Kontexten treffen.

Dafür brauchen sie ein Orientierungssystem. Die Verschränkung von Complexity Leadership Theory, Cynefin-Framework und einer epistemologisch fundierten KI-Kritik bietet ein solches System. Nicht als Checkliste, nicht als Modell, das man “implementiert”. Sondern als Denkrahmen, der hilft, die richtigen Fragen zu stellen, bevor man nach Antworten sucht, egal ob bei Menschen oder Maschinen.

Referenzen

Bach, J. (2009). Principles of Synthetic Intelligence PSI: An Architecture of Motivated Cognition. Oxford University Press.

Bach, J., & Sorensen, H. (2026). The Machine Consciousness Hypothesis. California Institute for Machine Consciousness.

Dell’Acqua, F., McFowland III, E., Mollick, E., Lifshitz-Assaf, H., Kellogg, K., Rajendran, S., Krayer, L., Candelon, F., & Lakhani, K. R. (2026). Navigating the Jagged Technological Frontier: Field Experimental Evidence of the Effects of AI on Knowledge Worker Productivity and Quality. Organization Science, 36(2). https://doi.org/10.1287/orsc.2025.21838

Kauffman, S. A. (1993). The Origins of Order: Self-Organization and Selection in Evolution. Oxford University Press.

Randazzo, S., Lifshitz, H., Kellogg, K. C., Dell’Acqua, F., Mollick, E., Candelon, F., & Lakhani, K. R. (2025). Cyborgs, Centaurs and Self-Automators: The Three Modes of Human-GenAI Knowledge Work and Their Implications for Skilling and the Future of Expertise. Harvard Business School Working Paper No. 26-036.

Snowden, D. J., & Boone, M. E. (2007). A Leader’s Framework for Decision Making. Harvard Business Review, 85(11), 68-76.

Uhl-Bien, M., Marion, R., & McKelvey, B. (2007). Complexity Leadership Theory: Shifting Leadership from the Industrial Age to the Knowledge Era. The Leadership Quarterly, 18(4), 298-318. https://doi.org/10.1016/j.leaqua.2007.04.002

Uhl-Bien, M., & Arena, M. (2017). Complexity Leadership: Enabling People and Organizations for Adaptability. Organizational Dynamics, 46(1), 9-20.

Uhl-Bien, M. (2021). Complexity Leadership and Followership: Changed Leadership in a Changed World. Journal of Change Management, 21(2), 144-162.

Leave A Comment