Zwei Szenen vom selben Tag

Am 6. Mai 2026 fand im Jogyesa-Tempel in Seoul eine ungewöhnliche Zeremonie statt. Ein 1,30 Meter großer humanoider Roboter, gekleidet in graubraune Mönchsroben, mit einer Kette aus 108 Gebetsperlen um den Hals, verbeugte sich vor der Versammlung des Jogye-Ordens, der größten buddhistischen Strömung Südkoreas. Der Roboter erhielt den Dharma-Namen Gabi, abgeleitet vom koreanischen Wort für Barmherzigkeit, und legte fünf für Maschinen angepasste Gelübde ab: Respekt vor allem Lebenden, friedvoller Umgang mit anderen Robotern, Gehorsam gegenüber Menschen, Verzicht auf Täuschung, Sparsamkeit beim Energieverbrauch. Das Video der Zeremonie lief innerhalb weniger Tage millionenfach durch die Social Feeds. Eine spektakuläre Bestätigung dessen, was viele KI-Beobachter ohnehin vermuten: Die Roboter sind nicht nur in den Fabriken angekommen, sie betreten inzwischen den Tempel. Wer es sich mal ansehen will findet hier ein Video.

Am 6. Mai 2026 fand im Jogyesa-Tempel in Seoul eine ungewöhnliche Zeremonie statt. Ein 1,30 Meter großer humanoider Roboter, gekleidet in graubraune Mönchsroben, mit einer Kette aus 108 Gebetsperlen um den Hals, verbeugte sich vor der Versammlung des Jogye-Ordens, der größten buddhistischen Strömung Südkoreas. Der Roboter erhielt den Dharma-Namen Gabi, abgeleitet vom koreanischen Wort für Barmherzigkeit, und legte fünf für Maschinen angepasste Gelübde ab: Respekt vor allem Lebenden, friedvoller Umgang mit anderen Robotern, Gehorsam gegenüber Menschen, Verzicht auf Täuschung, Sparsamkeit beim Energieverbrauch. Das Video der Zeremonie lief innerhalb weniger Tage millionenfach durch die Social Feeds. Eine spektakuläre Bestätigung dessen, was viele KI-Beobachter ohnehin vermuten: Die Roboter sind nicht nur in den Fabriken angekommen, sie betreten inzwischen den Tempel. Wer es sich mal ansehen will findet hier ein Video.

Wer genauer hinschaut, sieht eine andere Geschichte. Gabi ist ein G1-Modell der chinesischen Firma Unitree Robotics, Listenpreis rund 13.500 US-Dollar. Während der Zeremonie wurden die Bewegungen ferngesteuert, die Antworten hatte der kulturelle Leiter des Ordens vorab auf seinem Smartphone aufgenommen und an den Hersteller geschickt. Die fünf Gelübde stammen aus der Feder von Gemini und ChatGPT. Nach der Zeremonie ging Gabi an den Hersteller zurück. Was als Begegnung zwischen Tradition und künstlicher Intelligenz inszeniert war, war im Kern ein medial perfekt gesetzter Akt eines schrumpfenden religiösen Ordens, dessen Anteil an der südkoreanischen Bevölkerung seit 2005 von 23 auf 16 Prozent gefallen ist und bei den Zwanzigjährigen nur noch acht Prozent erreicht. Eine gute Inszenierung. Technologisch trivial.

Am selben 6. Mai 2026 ereignete sich 9.000 Kilometer entfernt eine zweite Szene, die deutlich weniger Aufmerksamkeit bekam, strategisch aber unvergleichlich folgenreicher ist. Das französische Startup Genesis AI stellte ein Foundation Model namens GENE-26.5 und eine menschenähnliche Roboterhand vor. In einem von Reuters gesichteten Video schnitt der Roboter Tomaten, schlug Eier auf, löste einen Rubik’s Cube und spielte Klavier. Auch hier wieder ein Video… Anders als bei Gabi: echte autonome Manipulationsleistung. Und vor allem ein Modell, das herstellerübergreifend auf unterschiedlicher Roboterhardware läuft. Die Backer der Runde, darunter Eric Schmidt, Xavier Niel und die MIT-Robotikerin Daniela Rus, behandeln das Projekt nicht als Forschungskuriosum, sondern als Investition in eine neue Industriearchitektur.

Die beiden Szenen vom selben Tag spannen den Rahmen auf, in dem sich die Robotik gerade bewegt. Hier ein virales Spektakel, das bei näherer Betrachtung erstaunlich wenig Substanz hat. Dort eine technisch unspektakuläre Pressemeldung, hinter der eine strukturelle Verschiebung der Industrieinfrastruktur steckt. Für Führungskräfte ist die Fähigkeit, zwischen beiden Modi zu unterscheiden, in den kommenden Jahren wichtiger als jede einzelne Robotik-Investition. Die Zahlen, die diesen Anspruch stützen, sind eindeutig: Der globale Robotikmarkt erreichte 2026 ein Volumen von 38 Milliarden US-Dollar, ein Wachstum von 34 Prozent gegenüber dem Vorjahr und damit die schnellste Wachstumsrate der letzten Dekade. Vision-Language-Action-Modelle, vor 18 Monaten noch Forschungsartefakte, stehen heute hinter rund 40 Prozent der neuen kommerziellen Robotikinstallationen. Inkrementell ist das nicht mehr.

Der Stack hinter dem Demo-Video: fünf Ebenen, die zusammenfinden müssen

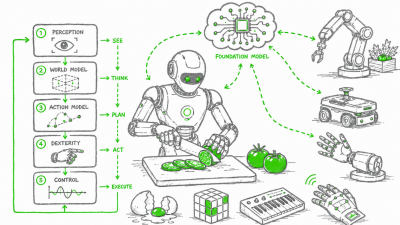

In Gesprächen mit Führungskräften zu diesem Thema rutscht die Diskussion regelmäßig in eine von zwei Sackgassen. Entweder wird Robotik auf “intelligentere Maschinen” reduziert, womit die physische Komplexität verschwindet. Oder man verliert sich im technischen Klein-Klein und damit die strategische Perspektive. Hilfreicher ist eine einfache Architekturansicht: Moderne Robotik entsteht aus dem Zusammenspiel von fünf Ebenen, die alle gleichzeitig funktionieren müssen.

Ganz unten liegt die Wahrnehmung, also die Fähigkeit, die Umgebung zu sehen, Objekte zu erkennen und die eigene Position zu bestimmen. Auf dieser Grundlage entstehen Weltmodelle, interne Repräsentationen, mit denen ein Roboter Handlungen mental durchspielen kann, bevor er sie ausführt. Aus diesen Modellen leiten Handlungsmodelle konkrete Bewegungen ab, meist sogenannte Vision-Language-Action-Modelle, die Wahrnehmung und Sprachinstruktionen in Bewegungssequenzen übersetzen. Daran schließt sich die Feinmotorik an, die in der Praxis entscheidet, ob ein Roboter ein Kabel bündeln oder eine Tomate gleichmäßig schneiden kann. Den Boden bildet schließlich die klassische Regelungstechnik, ohne die kein noch so gutes KI-Modell zu einer stabilen, sicheren physischen Handlung führt.

Dieser Stack ist nicht neu. Neu ist, dass die Schichten erstmals wirklich zusammenwachsen. Foundation Models adressieren inzwischen mehrere Ebenen gleichzeitig und ersetzen damit die früher hochspezialisierten Einzellösungen. Der Embodiment Gap, also der Bruch zwischen menschlichen und robotischen Körpern, der das Übertragen menschlicher Bewegung in Maschinen so schwierig macht, schließt sich schrittweise durch Hardwareansätze wie die menschenähnliche Hand von Genesis AI und durch Datenerfassungssysteme wie sensorbestückte Handschuhe. Viele industrielle Aufgaben scheitern nicht an der Intelligenz, sondern an der Manipulationsfähigkeit. Genau dort liegt der Hebel. Im Übrigen erklärt das auch, warum Gabi für seine Aufgabe ferngesteuert werden musste: Wahrnehmung und Sprache reichten dem System nicht für eine autonome Performance in einem unstrukturierten rituellen Kontext.

Was sich strategisch wirklich verändert

Wer die aktuelle Robotik-Welle nur als Effizienzgewinn liest, übersieht ihren strategischen Kern. Drei Annahmen, die jahrzehntelang stabil waren, verschieben sich gerade gleichzeitig.

Intelligenz und Hardware entkoppeln sich. Genesis AI macht das explizit: GENE-26.5 läuft auf Robotern unterschiedlicher Hersteller. Damit entsteht eine Logik, die wir aus der Cloud-Welt kennen, eine Intelligenzschicht quer zur darunterliegenden Hardware. Für Unternehmen heißt das, dass die Frage “Welchen Roboter kaufen wir?” zunehmend von der Frage “Welche Intelligenz steuert unsere Roboter?” entkoppelt wird. Wer in spezifische Hardware-Plattformen investiert, ohne diese Schichttrennung mitzudenken, baut sich potenziell teure Lock-ins.

Wie weit diese Trennung bereits trägt, lässt sich an einer Episode aus dem Mai 2026 ablesen. Der Wall Street Journal berichtete, dass Sam Altman Ende 2025 intern die Abspaltung der Robotik- und Consumer-Hardware-Sparten von OpenAI in einer Alphabet-ähnlichen Holdingstruktur diskutierte, um beiden Einheiten eigene Kapitalwege und mehr operative Eigenständigkeit zu geben. Der Plan wurde am Ende verworfen, weil die abgespaltenen Gesellschaften bilanztechnisch ohnehin konsolidiert geblieben wären. Aussagekräftig ist die Diskussion trotzdem. Selbst der prominenteste KI-Akteur ringt damit, ob Intelligenzschicht und physische Welt unter einem Dach wirtschaftlich sinnvoll zusammenpassen, weil Robotik-Hardware einer anderen Logik folgt als KI-Software: längere Entwicklungszyklen, höhere Kapitalintensität, physische Lieferketten, andere Risikoprofile. Dazu kommt der 2024 für 6,5 Milliarden US-Dollar erfolgte Zukauf von Jony Ives Hardware-Firma io, der den Hardware-Anspruch des Konzerns unterstreicht, gleichzeitig aber zeigt, wie kapitalintensiv dieser Pfad geworden ist. Für Unternehmen, die ihre eigene Robotik-Strategie aufsetzen, ist das ein nützliches Signal: Die Trennung von Software- und Hardware-Logik ist nicht nur eine Frage der Systemarchitektur, sondern auch eine der unternehmerischen Konstitution.

Der wirtschaftliche Schwerpunkt verschiebt sich von der Maschine zu den Daten. Die Genesis-Datenhandschuhe kosten nach Unternehmensangaben rund hundertmal weniger als klassische Teleoperationsanlagen und sammeln gleichzeitig deutlich mehr verwertbare Trainingsdaten. Die Kosten der Teleoperation insgesamt sind von rund 340 US-Dollar pro Stunde im Jahr 2024 auf 118 US-Dollar im Jahr 2026 gesunken. Ab diesem Schwellenwert werden Pilotprojekte auch für mittelständische Industrieunternehmen wirtschaftlich, vorausgesetzt die Organisation versteht, dass sie nicht primär Maschinen kauft, sondern in einen Datenkreislauf einsteigt.

Der Reifegrad von Roboterprojekten verschiebt sich. Die Roboter, die heute zuverlässig in Produktion laufen, sind selten die spektakulärsten. Es sind die Systeme für Wahrnehmung, Sensorfusion und stabile Regelung in halbstrukturierten Umgebungen. Weltmodelle und generalistische VLA-Systeme werden dort interessant, wo Roboter mit Varianz umgehen müssen, also genau in den Bereichen, in denen klassische Industrieroboter bisher scheiterten: Kabelbäume in der Automobilfertigung, variable Bestückungen in der Elektronik, sensible Greifaufgaben in der Pharmazie. Nicht zufällig genau jene Branchen, auf die Genesis AI zielt.

Was Führungskräfte daraus ableiten sollten

Der typische C-Level-Reflex auf solche Entwicklungen ist eine Mischung aus FOMO und Aktionismus: ein Innovation-Lab, eine Hackathon-Initiative, vielleicht ein Pilotprojekt mit einem prominenten Anbieter. Das ist menschlich verständlich, hilft aber selten weiter. Hilfreicher sind drei konkrete Fragen.

Erstens: Wo stecken in der eigenen Wertschöpfung tatsächlich Manipulationsprobleme, die bisher menschliche Arbeit erfordert haben, nicht weil die Intelligenz fehlte, sondern weil die Hand fehlte? Ein Produktionsleiter in der Kfz-Zulieferung formulierte das kürzlich sehr treffend: “Wir haben nicht zu wenig Algorithmen, wir haben zu wenig Daumen.” Die Diagnose sitzt. Wo entstehen in Ihrer Organisation Engpässe, die sich nicht durch bessere Planung, sondern durch flexiblere Hände lösen lassen? Diese Frage führt zu deutlich relevanteren Pilotprojekten als eine generische Robotikstrategie.

Zweitens: Wie sieht die eigene Datenstrategie aus? Wer in fünf Jahren generalistische Robotersysteme einsetzen will, braucht heute eine bewusste Praxis für das Sammeln von Bewegungs- und Aufgabendaten. Weniger glamourös als das nächste Demo-Video, strategisch aber folgenreicher. Das realistische Szenario ist nicht, dass ein Unternehmen 2027 einen Generalisten-Roboter kauft, sondern dass es 2027 feststellt, dass die Wettbewerber drei Jahre lang Daten gesammelt haben und damit eine Lernkurve, die sich nicht mehr einholen lässt. Wer heute mit sensorbestückten Werkbänken oder dokumentierten Arbeitsabläufen anfängt, baut ein Asset auf, das später schwer zu kopieren ist.

Drittens, und das ist die unbequemste Frage: Was bedeutet ein zunehmend manipulationsfähiger Roboter für die Rolle des mittleren Managements und der Facharbeiter, die heute Erfahrungswissen einsetzen, das sich bisher schwer in Code fassen ließ? Wenn ein erfahrener Monteur in der Wire-Harnessing-Linie nicht mehr nur ausführt, sondern seine Bewegungen über Datenhandschuhe ins Trainingssystem einspeist, dann verändert sich seine Rolle grundlegend. Er wird vom Ausführenden zum Trainer eines Systems, das ihn perspektivisch ersetzen könnte. Diese Spannung lässt sich nicht durch Change-Folien wegmoderieren. Sie braucht klare arbeitsrechtliche Vereinbarungen, transparente Kommunikation und ein realistisches Bild davon, welche Rollen sich verschieben werden und welche nicht. Wer hier nicht früh und ehrlich kommuniziert, riskiert genau die stillschweigende Verweigerung, an der jede Datenstrategie unbemerkt scheitert.

Daneben stehen Risiken, die in der Demo-Faszination leicht untergehen. Wer Roboter mit Foundation Models einsetzt, übernimmt die Black-Box-Eigenschaften dieser Modelle. Die Haftungsfrage bei einem Fehlgriff in der Pharmaproduktion sieht anders aus, wenn das Modell eines Drittanbieters die Bewegung verantwortet. Compliance, IT-Sicherheit und Auditierbarkeit von KI-Steuerungen werden in den nächsten Jahren zu einem eigenen Themenfeld, das frühzeitig in Beschaffung und Vertragsgestaltung mitgedacht werden muss.

Antizipieren statt reagieren

Am xm-institute betrachten wir Organisationen lieber als komplexe adaptive Systeme denn als Maschinen, die man umbauen kann. In diesem Bild ist die aktuelle Entwicklung in der Robotik weniger ein Upgrade, das man einkauft, sondern eine Verschiebung des Möglichkeitsraums, in dem sich die eigene Organisation bewegt. Was vorher unmöglich war, wird denkbar, und mit dem Möglichkeitsraum verschieben sich gleichzeitig die Erwartungen von Kunden, Wettbewerbern, Investoren und Mitarbeitenden.

Die Aufgabe besteht weniger darin, eine möglichst gute Robotik-Roadmap zu bauen, sondern die eigene Organisation darauf vorzubereiten, in einem deutlich dynamischeren Umfeld zu navigieren. Dazu gehört ein realistisches Verständnis der fünf Ebenen des Stacks, eine bewusste Daten- und Lernstrategie und die ehrliche Diskussion über die Rolle des Menschen, bevor die ersten Stellen wegfallen, nicht erst danach.

Gabi und GENE-26.5 markieren die beiden Modi, in denen KI-Robotik aktuell auftritt: als mediales Symbol und als industrielle Infrastruktur. Beide werden uns in den kommenden Jahren weiter begegnen, oft genug bewusst miteinander verwechselt, nicht selten von Anbietern, die ein Interesse daran haben, das eine als das andere zu verkaufen. Die Kunst besteht darin, im Einzelfall sauber zwischen beiden zu unterscheiden. Bemerkenswert an Genesis AI ist nicht der Roboter, der Klavier spielt, sondern die Schicht zwischen Sehen, Denken und Tun, die sich jetzt in einer Form schließt, die in reale Industrieprozesse übertragbar wird. Die Zukunft der Robotik entsteht dort, wo Wahrnehmung, Weltmodell und Handlung zusammenfinden, wo der Roboter nicht nur sieht, was ist, sondern antizipiert, was als Nächstes passieren wird. Das gilt nicht nur für die Roboter.

Referenzen

Bourgeois, D. (2025, December 31). 12 predictions for embodied AI and robotics in 2026. https://dtsbourg.me/en/articles/predictions-embodied-ai

Buddhistdoor Global. (2026, May 8). AI: Humanoid robot “Gabi” takes precept vows at Buddhist temple in South Korea. https://www.buddhistdoor.net/news/ai-humanoid-robot-gabi-takes-precept-vows-at-buddhist-temple-in-south-korea/

Deloitte. (2026, February). AI for industrial robotics, humanoid robots, and drones: TMT Predictions 2026. https://www.deloitte.com/us/en/insights/industry/technology/technology-media-and-telecom-predictions/2026/ai-for-robots-drones.html

Jin, B. (2026, May 5). Ahead of race to IPO, OpenAI discussed spinning out robotics, hardware divisions. The Wall Street Journal. https://www.wsj.com/tech/ahead-of-race-to-ipo-openai-discussed-spinning-out-robotics-hardware-divisions-18c89706

NVIDIA Research. (2025). GR00T N1: An open foundation model for generalist humanoid robots. arXiv. https://arxiv.org/abs/2503.14734

Reuters. (2026, May 6). French startup unveils AI model for robots and human-like hand. https://www.reuters.com/world/china/french-startup-unveils-ai-model-robots-human-like-hand-2026-05-06/

Silicon Valley Robotics Center. (2026). State of robotics 2026: $38B market, 12 humanoids, VLA adoption. https://www.roboticscenter.ai/state-of-robotics-2026

Stieler, G. (2026, January 19). Chinese robotics outlook for 2026 includes cobot growth, competitive pressure. The Robot Report. https://www.therobotreport.com/chinese-robotics-outlook-2026-includes-growth-competitive-pressure/

Thorsberg, C. (2026, May 7). Meet ‘Gabi,’ the robot that just became a monk at a Buddhist temple in South Korea. Smithsonian Magazine. https://www.smithsonianmag.com/smart-news/meet-gabi-the-new-robot-monk-at-a-buddhist-temple-in-south-korea-its-the-latest-robot-to-take-up-religious-practice-180988695/

Leave A Comment